Allerede på det første internasjonale toppmøtet om kunstig intelligens (KI) på Bletchley park i 2023, satte toppledere fra 30 nasjoner KI-risiko på dagsorden. De ble enige om å utarbeide et felles vitenskapelig kunnskapsgrunnlag, og den kanadiske KI-pioneren Yoshua Bengio ble bedt om å lede arbeidet.

I januar lanserte Bengio den andre internasjonale rapporten om KI-sikkerhet. Rapporten er utarbeidet i samarbeid med over 100 KI-eksperter fra 30 land og organisasjoner som OECD, FN og EU. Ekspertene advarer om flere alvorlige risikoer med de kraftigste KI-modellene:

- Risiko fra ondsinnet bruk. KI kan bevisst brukes til å forårsake skade. Eksempelvis kan kriminelle bruke stemmekloner av ekte mennesker for å lure familiemedlemmer til å overføre penger. KI medfører også en risiko for at ondsinnete aktører får hjelp til å utvikle biologiske og kjemiske våpen.

- Risiko fra feil og svikt. KI-systemer kan være upålitelige, gjøre feil, hallusinere eller oppføre seg på uventede og skadelige måter. KI-agenter representerer ytterligere risiko ved at de kan handle autonomt og gjøre feil som er vanskelige for mennesker å oppdage og stoppe i tide.

- Systemiske risikoer. Slike risikoer kan komme fra utstrakt bruk av KI på tvers av samfunnet og i næringslivet. Eksempelvis kan KI gradvis undergrave menneskers evne til å tenke og handle selvstendig. Rapporten viser blant annet til at klinikere som brukte AI-støtte over tid fikk svekket sin egen evne til å oppdage svulster uten KI-hjelp.

Oppfordringen fra ekspertgruppen er at samfunnet ikke kan vente på entydige bevis før man handler. Regulering og sikkerhetstiltak må utvikles parallelt med teknologien.

Dario Amodeis analyse av KI-risiko

Claude fra Anthropic er blant de aller kraftigste og mest brukte KI-modellene. I essayet Machines of Loving Grace beskrev selskapets toppsjef og grunnlegger Dario Amodei hvordan bidrag fra KI kan gi store fremskritt innenfor biomedisin og økonomisk utvikling. Nå har han beskrevet baksiden av medaljen i ett nytt essay The Adolescence of Technology, som ble publisert i januar. Der forklarer han hvordan kunstig intelligens nå befinner seg i sin «ungdomstid».

Å snakke om teknologiens ungdomstid er ikke så dumt. Det bærer med seg dobbeltheten i denne fasen av livet. På den ene siden er man full av energi og pågangsmot, men man preges også av umodenhet og dårlig dømmekraft.

For å gjøre risikoene konkrete bruker Amodei et tankeeksperiment: Forestill deg at en nasjon med 50 millioner mennesker plutselig oppstår rundt 2027, der alle er betydelig mer intelligente enn verdens fremste nobelprisvinnere, forskere og teknologer. De handler hundre ganger raskere enn folk flest. For hver tanke vi rekker å tenke, har de tenkt ti. Du er nasjonal sikkerhetsrådgiver. Hva bekymrer deg?

Amodei svarer selv ved å belyse fem risikoer:

- Autonomirisiko. Hva er intensjonene og målene til denne nye «nasjonen»? Er den fiendtlig, eller deler den våre verdier? Kan den dominere verden militært gjennom overlegne våpen, cyberoperasjoner eller påvirkningsoperasjoner?

- Masseødeleggelse. Kan ondsinnede aktører, både terrorister og kriminelle, bruke KI som et verktøy for å forsterke sin evne til å skade og drepe i en helt ny skala?

- Maktovertagelse. Kan en diktator, et autoritært regime, en næringslivsaktør eller en teknologigigant bruke KI til å skaffe seg makt over andre land eller over sin egen befolkning?

- Økonomisk destabilisering. Kan KI forrykke den globale økonomien, for eksempel ved å føre til massearbeidsledighet eller ekstrem konsentrasjon av rikdom?

- Indirekte og uforutsette effekter. Verden vil kunne endre seg svært raskt som følge av den nye teknologien og produktiviteten denne nasjonen skaper. Kan dette føre til destabilisering vi ikke har evne til å forutse?

To av Amodeis eksempler på hvordan KI kan brukes til maktkonsentrasjon (punkt 3) er blitt særlig aktuelle:

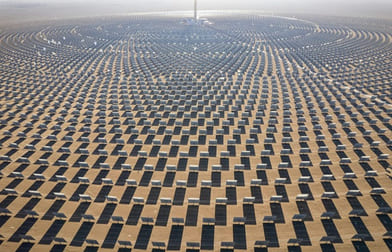

- Autonome våpen: En sverm av KI-styrte droner kan bli en uslåelig hær. Denne hæren kan beseire andre lands militærstyrker og undertrykke intern dissens i eget land ved å følge med på hver enkelt innbygger. Krigen i Ukraina viser at droner allerede er en realitet. Foreløpig er de ikke autonome og de illustrerer bare en brøkdel av hva fullt autonome AI-styrte systemer kan gjøre.

- KI-overvåking: Kraftig KI kan etter hvert lese og forstå all verdens elektroniske kommunikasjon. Det kan bli enkelt å lage en komplett liste over alle som er uenige med myndighetene, selv om de aldri har sagt det eksplisitt. Ved å analysere milliarder av samtaler kan systemet oppdage gryende opposisjon og slå den ned før den har rukket å spre seg. Det kan føre til et moderne panoptikon – et samfunn der ingen kan skjule seg.

Dario Amodei understreker at bruk av KI både til autonome våpen og til overvåking kan være legitimt. Men siden KI-modellene er så kraftige og kan misbrukes av både diktaturer og demokratier, så må vi bekymre oss.

Dernest diskuterer Amodei hvem som kan utgjøre en risiko for å utnytte KI på denne måten. Ikke overraskende viser han til Kina, som er den nasjonen som etter USA har best KI-kapasitet. Men han beskriver også hvordan demokratier kan utnytte KI-verktøy, ikke bare for å forsvare seg, men også mot egne innbyggere.

Normalt har demokratier institusjonelle sikkerhetsventiler som hindrer militæret og etterretningstjenestene i å slå ned på egen befolkning. Men dette er mulig å omgå. Amodei mener at slike sikkerhetsventiler allerede er i ferd med å svekkes i flere demokratier.

Han har også forslag til hvordan denne type risiko kan håndteres, eksempelvis ved å ikke selge chips til Kina, og å gjøre KI tilgjengelig for forsvaret i USA og deres allierte. Likevel er det viktig å trekke en tydelig grense mot misbruk av KI også innenfor demokratier. Det må finnes klare begrensninger for hva myndigheter kan gjøre med KI, slik at teknologien ikke brukes til å konsentrere makt eller undertrykke egen befolkning.

Amodei foreslår følgende prinsipp: vi bør bruke KI til nasjonalt forsvar på alle måter – bortsett fra på måter som gjør oss mer lik våre autoritære motstandere.

Anthropics prinsipper koster dem kontrakten med det amerikanske forsvaret

Det tok ikke lang tid før Dario Amodei fikk testet sine bekymringer i praksis, da han holdt fast på sine prinsipper i møte med det amerikanske Forsvarsdepartementet.

Anthropic var det første selskapet som fikk godkjent sin KI-modell Claude i klassifiserte nettverk. Kontrakten hadde en øvre ramme på 200 millioner dollar. Forsvarsdepartementet krevde at KI-modellen måtte kunne brukes til «all lawful purposes», altså ethvert lovlig formål. Antrophic ønsket to begrensninger: at teknologien ikke skulle brukes til masseovervåking av amerikanske innbyggere, eller til autonome dødelige våpensystemer uten menneskelig kontroll. Begrunnelsen var at dagens KI-modeller ikke er pålitelige nok til å brukes i fullt autonome våpensystemer, og at masseovervåking av amerikanske innbyggere ville innebære et brudd på grunnleggende rettigheter.

I dagens politiske situasjon i USA er vi blitt vant til at både enkeltpersoner, selskaper og andre nasjoner føyer seg etter Trump-administrasjonens vilje. Ikke minst er toppledere i store teknologiselskaper som xAI og OpenAI ivrige støttespillere, både politisk og økonomisk. Det var derfor ikke gitt at Anthropic skulle holde fast på de prinsippene Dario Amodei hadde beskrevet bare uker tidligere. Men Antrophic valgte å ikke gå med på vilkårene, og forsvarsminister Hegseth brøt med selskapet.

Denne saken reiser en rekke spørsmål. Hvilke regler gjelder når KI-lover nærmest er fraværende, slik som i USA? Er KI prinsipielt annerledes enn annen teknologi og utstyr? Hvordan kan en demokratisk regjering tenkes å utnytte KI i krig, og mot egne innbyggere? Saken er samtidig nok et eksempel som understreker behovet for å heve diskusjonen om økt digital suverenitet i Norge og i Europa.